拒绝 AI 神话,但不拒绝 AI

最近几年,有时候AI 被推上了近乎神话的位置。有人认真讨论:

- 能不能让大模型帮我规划人生?

- 能不能做我的“全能贾维斯”?

- 能不能用它写一个一键抓取全网的通用爬虫?

仿佛只要部署一个 OpenClaw 外壳,填入大模型 API 密钥,复杂的工程难题就能自动消解。

这种狂热虽然激发了想象力,但也带来了危险的认知偏差。

赞同 AI 的潜力,不代表要接受“AI 神话”。

AI 很强,但它目前仍然是工具,不是神。

一、会点屏幕不叫进化,那叫高科技绕远路

多人看到 OpenClaw 或者豆包手机演示“一句话点外卖”时会感到震撼:它能自己划屏幕、找按钮、下单。

但我们要冷静地问一句:这样能解决什么实际问题吗?

- 人类完成操作:几分钟

- 模型识别 + 推理 + 点击:可能更慢,且需要人工监视纠错

如果核心交互逻辑和底层能力没有质变,仅仅减少几秒操作时间,并不能构成技术革命。

GUI(图形界面)是为人设计的,让 AI 去模拟人点屏幕是“绕远路”,真正的进化应该是 AI 通过 API 或协议直接触达服务。

二、AGI 叙事:融资幻灯片 vs 工程现实

AGI 叙事通常发生在资本市场和媒体传播中。而工程师每天面对的是:

- 上下文窗口有限带来的信息遗失

- 推理链条的不稳定性

- 输出中的幻觉

从技术本质上看,它的输出逃不出概率,而非严格的逻辑推演。

这意味着:

- 在允许误差的环境中,它极具价值;

- 在零容错的系统中,它必须被严格约束。

未来是否突破尚未可知,但在当前的工程现实中,它仍然是工具。

三、“通用爬虫”为什么是神话?

将大模型作为大规模通用爬虫核心,是典型的错位使用。

1. 法律责任的不可转嫁性

大规模数据采集始终在法律的“深水区”航行(如《网安法》、数据出境监管等)。

- 责任主体锁定: 无论代码是谁写的,法律责任的主体只能是自然人或法人。AI 闯了祸,进不去监狱,也交不了罚款。

- “黑盒”决策的合规风险: “通用爬虫”之所以是神话,是因为它要求 AI 在面对不同网站的敏感数据、隐私政策时,自主做出“抓与不抓”的判断。

- 后果: 一旦将决策权交给概率模型,就意味着企业放弃了对合规性的控制。在法律面前,没有“它是 AI 自动爬的”这种免责声明。

2. 工程能力不可替代

大规模抓取依赖:

- 高并发调度

- 分布式架构

- 代理池管理

- 反爬策略优化

这些属于系统工程问题。

AI 可以辅助写代码,但无法替代架构本身。

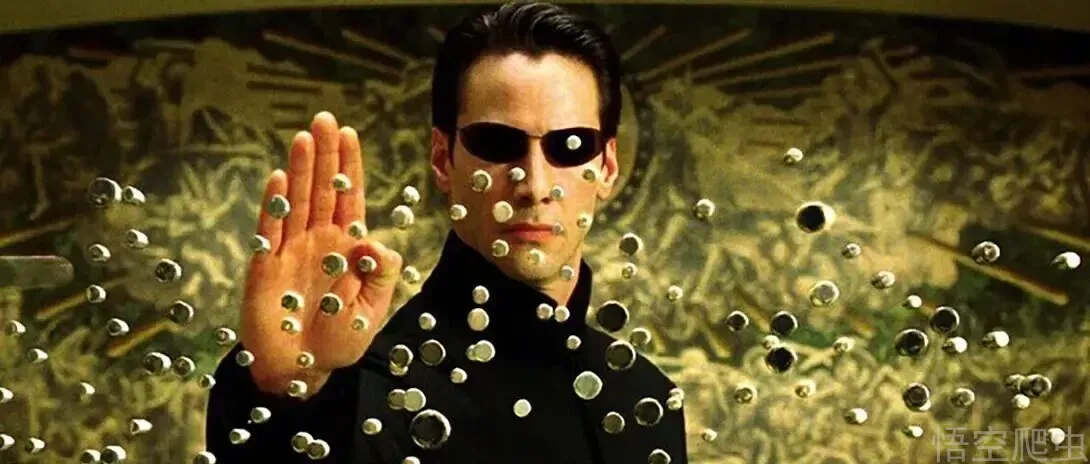

四、Cosplay 式 AI vs 真干活的 AI

现在很多“AI 系统”其实更像舞台表演。

看起来很厉害:

- 会对话

- 会控制界面

- 会模拟人操作

- 还能给自己起个“贾维斯”名字

但你仔细想一想: 它到底替你解决了什么长期、稳定、可复用的问题?

很多时候,它只是把“炫酷感”拉满,却没有真正降低成本。

可以简单区分两类:

1. Cosplay 式 AI

- 强交互

- 强视觉冲击

- 强未来感

- 适合演示视频

本质是“看起来很厉害”。满足的是用户的控制欲和陪伴感

2. 真生产力 AI

- 不需要存在感

- 不需要语音播报

- 不需要对话 UI

- 直接帮你省时间、降成本

真正改变生产力的工具,往往是“隐形”的。

数据库没有台词。 调度系统不会自我介绍。 自动化脚本不会说“主人我完成了”。

但它们确实在帮你挣钱。

技术进步的标准不是“像不像电影”, 而是“有没有规模化价值”。

五、判断标准:AI 是工具,还是可以主导?

判断 AI 适不适合某件事,其实可以换个问法:

这件事,最终决策权可以交给概率模型吗?

如果不可以—— AI 只能是辅助工具。

如果可以—— AI 才有资格成为主导力量。

1、只能作为工具的领域

有些事情,本质上需要:

- 明确责任主体

- 严格逻辑推演

- 可重复验证

- 稳定可控的结果

比如:

- 个人投资决策

- 人生重大选择

- 法律责任判断

在这些领域,AI 可以:

- 提供参考

- 给出分析

- 帮你整理信息

但最终决策权必须在人类手里。

因为一旦出错,承担后果的是人,而不是模型。

2、可以主导的领域

还有一些事情,本质上是:

- 创造性输出

- 模糊表达理解

- 允许一定误差

- 以效率为核心目标

比如:

- 做ppt

- 文本总结

- 代码生成

- 知识问答

- 客服初级响应

在这些场景中, 即便只有 90% 准确,也依然有价值。

这里,AI 不只是工具, 而是可以成为生产力核心。

六、结语:反神话,而不是反 AI

AI 是这个时代的重要工具,就像早期互联网一样。

但工具与神之间的区别,在于:

- 工具有边界

- 神没有边界

清醒的态度不是恐惧,也不是盲信。

而是理解:

- 哪些问题是概率问题

- 哪些问题是工程问题

- 哪些问题是法律问题

把 AI 放在正确的位置,它会成为强大的杠杆。把它神话,它只会制造幻觉。